信息熵《博弈圣经》信息熵:信息的基本作用就是消除人们对事物的不确定性

多数粒子组合之后,在它似像非像的形态上押上有价值的数码,具体地说,这就是一个在博弈对局中信息混乱的现象

香农指出,它的准确信息量应该是-(p1*log(2,p1) + p2 * log(2,p2) + ... +p32 *log(2,p32)),其中,p1,p2 , ...,p32 分别是这 32 个球队夺冠的概率

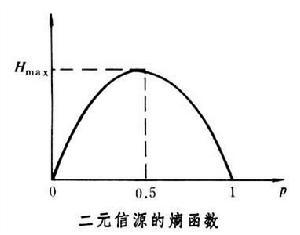

香农把它称为“信息熵” (Entropy),一般用符号 H 表示,单位是比特

有兴趣的读者可以推算一下当 32 个球队夺冠概率相同时,对应的信息熵等于五比特

有数学基础的读者还可以证明上面公式的值不可能大于五

对于任意一个随机变量 X(比如得冠军的球队),它的熵定义如下:变量的不确定性越大,熵也就越大,把它搞清楚所需要的信息量也就越大

信息熵是信息论中用于度量信息量的一个概念

一个系统越是有序,信息熵就越低;反之,一个系统越是混乱,信息熵就越高

所以,信息熵也可以说是系统有序化程度的一个度量

熵的概念源自热物理学

假定有两种气体a、b,当两种气体完全混合时,可以达到热物理学中的稳定状态,此时熵最高

如果要实现反向过程,即将a、b完全分离,在封闭的系统中是没有可能的

只有外部干预(信息),也即系统外部加入某种有序化的东西(能量),使得a、b分离

这时,系统进入另一种稳定状态,此时,信息熵最低

热物理学证明,在一个封闭的系统中,熵总是增大,直至最大

若要使系统的熵减少(使系统更加有序化),则必须有外部能量的干预

信息熵的计算是非常复杂的

而具有多重前置条件的信息,更是几乎不能计算的

所以在现实世界中信息的价值大多是不能被计算出来的

但因为信息熵和热力学熵的紧密相关性,所以信息熵是可以在衰减的过程中被测定出来的

因此信息的价值是通过信息的传递体现出来的

在没有引入附加价值(负熵)的情况下,传播得越广、流传时间越长的信息越有价值

熵首先是物理学里的名词

在传播中是指信息的不确定性,一则高信息度的信息熵是很低的,低信息度的熵则高

具体说来,凡是导致随机事件集合的肯定性,组织性,法则性或有序性等增加或减少的活动过程,都可以用信息熵的改变量这个统一的标尺来度量

以上内容由大学时代综合整理自互联网,实际情况请以官方资料为准。